Eigene Compliance-Prozesse werden oft als statisch und aufwändig erachtet. Intelligent verankert hat der Compliance-Bereich jedoch eine Schlüsselrolle zur effektiven und gesetzeskonformen Förderung von datengetriebenen Innovationen.

Vielfach herrscht bei technologieaffinen Unternehmen in Europa die Meinung, dass die Gesetze, Standards und Regeln rund um Datenschutz und Sicherheit weitreichende Innovationen verhindern. Durch harsche Gesetze würde Europa weit hinter China und Amerika zurückfallen, so der Tenor. Die Daten, die produziert werden, oder produziert werden könnten, lassen sich demnach nicht für datengetriebene Innovationen nutzen. Vermeintliche Konsequenz: Noch immer stammen nur wenige datengetriebene Innovationen aus Europa.

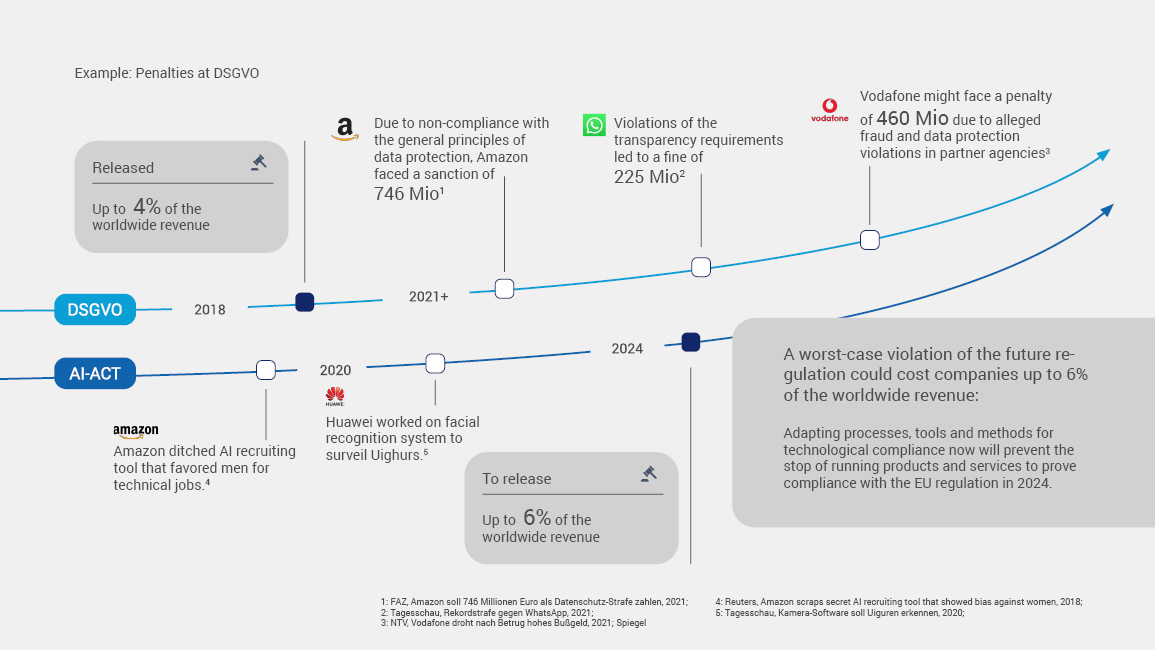

Um wettbewerbsfähig zu bleiben, sind Innovationen für Unternehmen unerlässlich. Wird aber Datenschutz nicht einbezogen, kann dies für Unternehmen oder sogar Einzelpersonen weitreichende Folgen haben. Bis zu 4 Prozent des weltweiten Jahresumsatzes oder bis zu 20 Millionen Euro sieht die Datenschutz-Grundverordnung bei einem Verstoß vor. Werden Straftaten im Umgang mit Daten begangen, wie z.B. die unberechtigte, wissentliche Datenübermittlung von personenbezogenen Daten einer großen Anzahl von Personen an Dritte, droht sogar eine Freiheitsstrafe von bis zu drei Jahren. Zwar wurden seit der Einführung des Datenschutzgesetzes 2018 eher geringe Strafzahlungen verhängt, diese Schonfrist scheint nun aber beendet. So wurden in der EU allein im dritten Quartal 2021 Strafen von fast einer Milliarde Euro, unter anderem auch an Unternehmen wie Amazon oder WhatsApp, verhängt.

Auch andere technologische Entwicklungen und Innovationen werden nun mit Gesetzen reguliert: So liegt seit April 2021 der Gesetzesentwurf für vertrauenswürdige künstliche Intelligenz vor, welcher bei Verstößen bis zu 6 Prozent des weltweiten Jahresumsatzes als Strafe zur Folge haben kann.

Im operativen Umfeld der Unternehmen stellt die Umsetzung der DSGVO ein massives Geschäftsrisiko dar. So beschreibt eine Bitkom-Studie, dass drei Viertel von 502 befragten Unternehmen angeben, dass Innovationsprojekte aufgrund konkreter Datenschutzvorgaben gescheitert seien. In neun von zehn Unternehmen wurden zudem Projekte wegen Unklarheiten im Umgang mit der DSGVO gestoppt.

Umsetzung der Regulierung birgt große Herausforderungen

In einer Analyse hat Detecon bei Unternehmen, die datengetriebene Innovationsprojekte im Umgang mit neuen Technologien aufgeben mussten, insbesondere drei Problemfelder identifiziert:

- Die Einflüsse und Anforderungen der relevanten Datenschutzverordnung wurden nicht von Beginn an in die Entwicklung mit einbezogen. Erfolgt diese Analyse der Auswirkungen verspätet, zieht dies in der Regel aufwändige Iterationsschleifen nach sich.

- Eigene Compliance-Prozesse werden als statisch, kompliziert und aufwändig erachtet und erfordern zudem viele, teils externe Ressourcen für Audits und Beratung. Außerdem sind viele Prozesse noch nicht an neue Verfahren wie Machine Learning oder Data Self-Services angepasst, bei denen Mitarbeiter selbständig auf Data Lakes zugreifen, um Prozesse zu simulieren. Werden diese Compliance-Prozesse erst gegen Ende des Entwicklungsprozesses durchgeführt, erschwert dies das Projekt enorm und führt im schlimmsten Fall zur Aufgabe.

- Einige Unternehmen unterbinden grundsätzlich den Einsatz bestimmter Technologien, wie die Verwendung von Machine Learning oder die Nutzung eigener Daten, aufgrund von Komplexität und Unklarheiten in der Auslegung. Dies führt unweigerlich zu einer verminderten Prozessinnovation innerhalb des Unternehmens.

Grundsätzlich scheinen vielfach sowohl das Bewusstsein für Gesetze und Regelungen als auch praxisnahe Informationen zu fehlen. Außerdem werden Technologien oder Verfahren auch ganzheitlich verboten, da ein Framework und die Governance für sichere Innovationsverfahren fehlen. Demnach lässt sich folgende Hypothese bilden:

Hypothese:

Der Compliance-Bereich hat eine Schlüsselrolle im Prozess zur datenzentrierten Innovationsfähigkeit. Er ist Brücke und Übersetzer zwischen Unternehmen und Gesetzgeber. Intelligent verankert ermöglicht er datengetriebene Innovationen durch Unterstützung, Übersetzung und Hilfestellung.

Um den Fachbereichen bei der Arbeit mit innovativen Technologien einen abgesicherten Rahmen zur praxisnahen Anwendung der Gesetze und Leitlinien zur Verfügung zu stellen, bedarf es von Anfang an eines ganzheitlichen Compliance Framework.

Framework hält Mensch und Technologie im Fokus

Ziel eines Compliance Framework ist es, eine gesetzeskonforme Einführung datengetriebener Technologien zu ermöglichen, ohne den Innovationswert zu mindern. Prinzipiell soll das Framework Haftungs- und Reputationsschäden vermeiden.

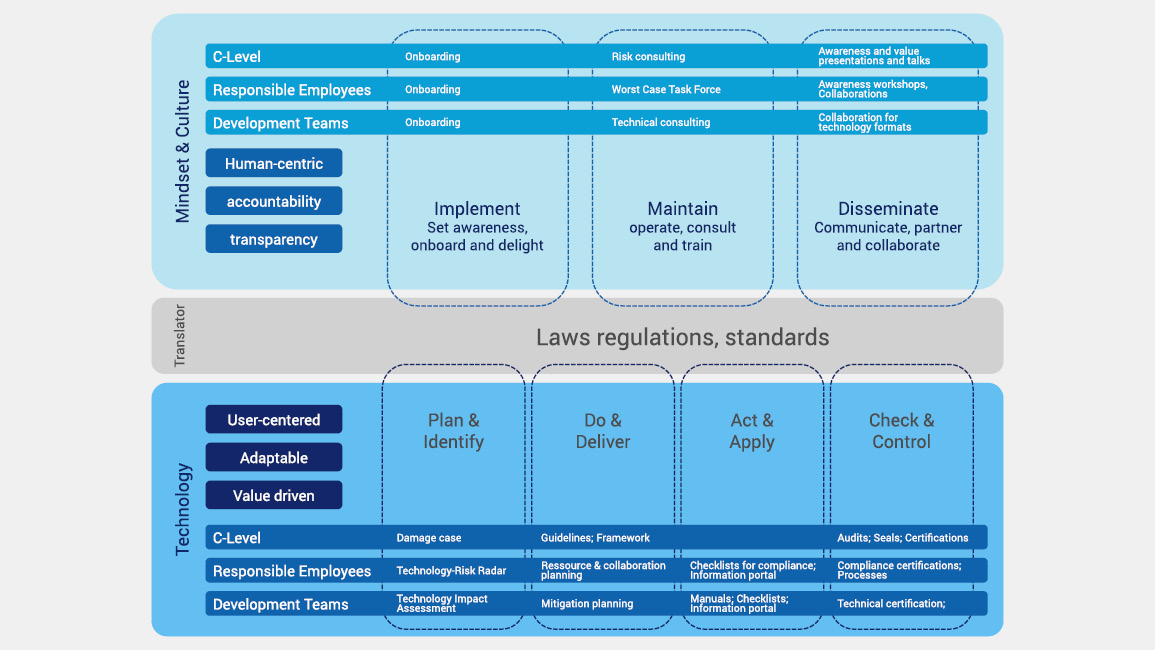

Der Compliance-Bereich nimmt die Rolle des Übersetzers von Gesetzen, Regulatorik und Standards ein. Darüber hinaus sichert er das Commitment des Unternehmens zu den individuell bestimmten Werten. So entwickeln mehr und mehr Unternehmen etwa Leitlinien für künstliche Intelligenz, bei denen ebenfalls der Bedarf entsteht, sie in Praxisverfahren zu übersetzen.

Aufbau eines Compliance Framework

Im in Abbildung 2 dargestellten Compliance Framework bilden Gesetze und Standards die Basis für die Ebenen von „Technologie“ sowie „Mindset & Culture“, auf denen die einzelnen Initiativen aufgebaut werden.

Die Ebene „Mindset & Culture“ fokussiert insbesondere darauf, das erforderliche Wissen zu den relevanten Gesetzen und Werten zu vermitteln und zu vertiefen. Prinzipien wie Human-zentriert, Transparenz und Verantwortungsbewusstsein sind hier essentiell. Konkrete Handlungsfelder dazu sind:

- Schaffen von (Verantwortungs-)Bewusstsein und Aufbau von Wissen:

Entwicklungen müssen sich im gesetzlichen Rahmen bewegen. Diese Nachricht muss im Unternehmen auf jeder Ebene bekannt sein und alle Mitarbeiter*innen sollten sich ihrer individuellen Verantwortung bewusst sein. Aus diesem Grund bieten viele Compliance- Abteilungen konkrete Onboarding Trainings, in denen auch neuen Mitarbeitern von Beginn an praxisrelevantes Basiswissen zu Gesetzen vermittelt wird. Haben Mitarbeiter Werte und Regulatorik verinnerlicht, entsteht auch ein klares Profil in der Außenwelt.

- Erhalten von Maßnahmen und Betreuung von Beratungsangeboten:

Werden neue Technologien im Unternehmen genutzt, treten oft Fragen auf, welche selten von den Entwickler*innen allein lösbar sind. Daher ist es wichtig, ein unbürokratisches Beratungsangebot mit Compliance-Experten bereitzustellen, damit Hindernisse schnell behoben werden können.

- Kommunikation und Partnerschaften:

Transparenz über Werte und Konformität ist für Kunden ein wichtiger Kauffaktor. Daran orientierte Kommunikationskampagnen können Werte stärken und Wettbewerbsvorteile bilden. Partnerschaften sind hilfreich, um Best Practices zu erhalten oder sich strategisch gemeinsam aufzustellen. Bei Gesetzesvorschlägen, wie zum Beispiel dem AI Act, ist der gemeinsame Austausch zur frühzeitigen Umsetzung sehr wertvoll. Ergebnisse aus der Zusammenarbeit können die Gesetzgebung sogar noch maßgeblich beeinflussen.

Die Ebene „Technologie“ sollte die technologische Einführung in einer nutzerorientierten, anpassbaren und werteorientierten Weise orchestrieren. Sie zeichnet sich durch die Zusammenarbeit mit den jeweiligen Fachabteilungen aus, die eine spezifische Technologie betreuen oder einsetzen.

- Identifikation und Analyse potenzieller Risiken neuer Technologien und Verfahren für Haftung oder Reputation:

Technologien, die strategisch für das Unternehmen künftig eine wichtige Rolle einnehmen, aber auch maßgeblich Regulatorik unterliegen, sind durch Radar-Tools oder Impact-Maps zu identifizieren. Zum Beispiel kann das Zusammenspiel von sozialen und politischen Einflüssen auf eine Technologie erst dazu führen, dass diese unter bestimmte Gesetzesanforderungen fällt. Ein Beispiel hierfür ist die Nutzung von künstlicher Intelligenz im HR-Bereich. Der Gesetzesvorschlag des AI Act sieht vor, dass die Nutzung hier nur unter hohen Auflagen erfolgen kann.

- Definition von Leitlinien und Prinzipien:

Die im ersten Schritt identifizierten Technologien oder Praktiken werden nun analysiert. Zudem wird ein Zielbild für den Umgang mit ihnen definiert. Dieses Zielbild skizziert Prinzipien, welche auf der Gesetzesgrundlage, aber auch auf unternehmenseigenen Werten basieren. So legen viele Unternehmen selbst verbindliche Leitlinien für den Umgang mit künstlicher Intelligenz fest, die oftmals weiter als die (zukünftige) Regulierung gefasst sind.

- Gestaltung anwenderfreundlicher und praxisnaher Maßnahmen, Tools und Methoden:

Die Leitlinien und Prinzipien werden im nächsten Schritt in die Praxis übertragen, damit sie auf der jeweiligen Verantwortungsstufe und im berufsbezogenen Kontext verständlich sind. Die Auswahl der Themen, wie zum Beispiel der Umgang mit Daten im Zusammenhang mit künstlicher Intelligenz, aber auch die Methode sollten in Zusammenarbeit mit den Nutzern entwickelt werden, um die Akzeptanz zu maximieren. Dabei sind auch kreative Methoden denkbar, wie ein Chatbot, der auf verschiedene Fragen schnell eine Antwort findet, an Stelle eines Handbuchs.

- Entwicklung von Überprüfungsmaßnahmen:

Zuletzt werden Tools, Maßnahmen, Prozesse und Methoden entwickelt, die prüfen, ob die zuvor festgelegten Richtlinien auch tatsächlich in die jeweilige Technologie implementiert wurden. Zum Beispiel kann ein ethisches Siegel helfen, zu überprüfen, ob die zuvor festgelegten Leitlinien zum Umgang mit künstlicher Intelligenz eingehalten wurden.

Nutzerzentriertes Vorgehen zum gesetzeskonformen Einsatz von Technologien

Je früher Gesetze, Richtlinien und Standards in die Entwicklung eingebunden werden, desto sicherer sind Produkt oder Service und langwierige Nachbesserungsprozesse sind minimiert. Im besten Fall entsteht eine Win-Win-Situation, die nicht nur die Gesetzeskonformität garantiert, sondern auch Mehrwert für die Nutzer schafft, etwa durch online nutzbare Zertifikate.

Folgende Schritte sind für eine Nutzerzentriertes Vorgehen wesentlich:

- Legen Sie das Ziel und die gewünschte Wirkung der Initiativen fest:

Definieren Sie die lang- und kurzfristigen Auswirkungen, die Sie mit den Aktivitäten erzielen wollen. Dies stellt sicher, dass das Team und alle Interessengruppen auf dieselbe Vision hinarbeiten. Legen Sie die Erwartungen für die langfristigen Veränderungen fest. Definieren Sie, nach welchen Prinzipien und Werten Sie agieren. Gehen Sie der Gefahr aus dem Wege, in erster Linie nur die Gesetze oder Technologie in den Fokus aller Aktivitäten zu rücken. Adressat des Handelns sollten vor allem die Anwender sein. Arbeiten Sie auf Augenhöhe mit den Nutzern zusammen und entwickeln Sie anwendungsfreundliche Tools, Methoden und Prozesse die die User Journey bereichern.

- Den Technologiefokus bestimmen (Plan & Identify):

Der Start erfolgt mit der Identifikation von Technologien und Verfahrensfehlern, die Reputations- oder Haftungsschäden auslösen könnten. Mit Blick auf die eigene Strategie, Geschäftsmodelle und Use Cases wird strukturiert analysiert, welche Auswirkungen drohen und somit eines gesteuerten Umgangs bedürfen.

- Den Handlungsrahmen bestimmen (Do & Deliver):

Im nächsten Schritt wird der Handlungsrahmen hinsichtlich der unterschiedlichen Systeme oder Technologien und Datenkategorien aufgezeigt. Beispielsweise sind in Bezug auf die Verarbeitung von personenbezogenen Daten die Grundsätze der Verarbeitung im Sinne von Art. 5 DSGVO zu beachten. Dazu zählen Rechtmäßigkeit, Transparenz, Zweckbindung, Richtigkeit, Integrität und Vertraulichkeit der Verarbeitung sowie die Rechenschaftspflicht. Je Technologie, System oder Praktik kann sich der Handlungsrahmen weiter individualisieren. Vor dem Einsatz von ethisch orientierter Künstlicher Intelligenz kann ein individueller Wertekatalog eines Unternehmens den Handlungsrahmen abbilden.

- Definiere die Nutzer:

Der nächste Schritt dient der Identifikation aller Stakeholder und Nutzer. Hierzu werden alle Personen betrachtet, die künftig dafür zuständig sind, Produkte und Services DSGVO- und Wertekonform zu entwickeln und zu betreiben oder dies verantworten. Beschreiben Sie zusätzlich deren (persönlichen) Bedarfe, Interessen und die Zusammenhänge der Nutzer. Es sollten vor allem auch Pain Points herausgearbeitet werden, die die Nutzer hinsichtlich der Einbindung von Regulatorik oder Leitlinien haben. Nutzerinterviews oder Umfragen können später dabei helfen, sich für bestimmte Initiativen zu entscheiden oder zu priorisieren. Klassifizieren Sie anschließend die Nutzergruppen. Verschiedene Klassifizierungen helfen dabei, die richtigen Tools für eine Gruppe anzubieten. Beispielhafte Abstufungen von Nutzergruppen können zum Beispiel unterschiedliche Verantwortungsstufen sein, oder Gruppen, welche in unterschiedlichen Produktlebenszyklen der Technologie beteiligt sind.

- Verstehen der Bedarfe je Nutzergruppe:

Definieren Sie nun das Verhalten je Nutzergruppe und recherchieren Sie alle Aspekte, die das Verhalten der Nutzer*innen ermöglichen oder behindern könnten (Prozesse, Produktlebenszyklen etc.). Ziehen Sie Mitarbeiter*innen hinzu, die über gute Erfahrungen und Kenntnisse der Probleme oder deren Kontext verfügen. Bleiben Sie nicht in Ihrem Silo, sondern fokussieren Sie sich auf die Belange der Nutzer*innen. Bei Recherchen und Interviews mit relevanten Stakeholdern im datenzentrischen Umfeld lässt sich oft feststellen, dass die Umsetzung ethischer Werte aufgrund spezifischer Anforderungen auf der Ebene der technologischen Entwicklung Probleme aufwirft. Nicht nur werden die Vorschriften oft nicht verstanden. Durch die unterschiedlichen Rollenbilder kann auch das individuelle Verantwortungsbewusstsein für den Umgang mit Daten nicht bewusst wahrgenommen werden.

Darüber hinaus sind weitere Problemfelder evident:

1. Das Fehlen von einfach verständlichen und praxisnahen Informationen.

2. Das Verständnis darüber, ob und inwieweit die DSGVO oder andere Regulierungen und deren spezielle Anforderungen für bestimmte Systeme angewendet werden müssen.

3. Unklarheit über die Implementierung der Gesetze in die entsprechende Phase des Entwicklungs-Lifecycle.

4. Aufwändige und komplizierte Audits und Überprüfungssysteme kurz vor Launch des Systems.

-

Challenge für den Bedarf einer Nutzergruppe:

Ein praxisbewährtes Instrument, um die Bedarfe einer Nutzergruppe zu klären, sind sogenannte Challenge-Workshops. Hierbei wird eine Challenge konzipiert, um das Ziel, den Bereich, und den Umfang von Maßnahmen zu definieren. Beim Definieren der Challenge geht es um die Sicherstellung, dass im Projekt die relevanten Aufgaben, die zu einem erfolgreichen Produkt führen, erledigt werden. Das definierte Ziel hilft, während des gesamten Projekts den Fokus zu halten. Die visualisierte Challenge hilft auch während des Projekts bei schwierigen Diskussionen und Entscheidungen. Definieren Sie die Challenge so genau wie nötig, aber so offen wie möglich, um Spielraum für den anschließenden Schritt der Lösungsfindung zu geben. - Lösungsfindung: Fünf Schritte, um die Challenges zu lösen:

1. Wählen Sie die Nutzergruppe aus, für die in Folgendem ein Problem gelöst werden soll, stellen Sie deren Needs und Kontext, deren alltägliche Arbeit und Prozesse dar

2. Analysieren Sie die Regulierung und finden Sie heraus, was sie in Bezug auf den Nutzer und die Technologie bedeutet

3. Generieren Sie Ideen, welche Art von Übersetzungshilfe, Tool oder Methode der ausgewählten Nutzergruppe helfen könnte, damit sie die Produkte und Services gesetzeskonform entwickeln und betreiben kann. Berücksichtigen Sie die dargestellten Informationen über den Nutzer und dessen Kontext. Priorisieren Sie die Ideen danach, wie sich diese Initiative in den Kontext des Nutzers einfügt und ob eine Win-Win-Situation generiert wird

4. Gestalten Sie möglichst früh Prototypen und testen Sie diese mit der Nutzergruppe. Prüfen Sie, ob deren Needs erfüllt werden und die Nutzenden die Initiative selbständig betreiben können

5. Priorisieren Sie für die Initiative eine schnelle Entwicklung und einen Launch, der im weiteren Betrieb möglichst einfach adaptiert werden kann und welcher zunächst hauptsächlich die Grundbedürfnisse erfüllt. Holen Sie sich immer proaktiv Feedback ein und verbessern Sie die Prozesse und den Inhalt kontinuierlich.

Beispiele für mögliches Maßnahmen-Portfolio

Abgeleitet aus den oben benannten Problemfeldern, lässt sich auf diese Weise mit der Nutzergruppe ein vollumfängliches Maßnahmen-Portfolio erstellen, welches die Integration der individuellen Wertevorstellungen und der DSGVO vereinfacht, die Sicherheit bei allen Verantwortlichen erhöht und sich in die Arbeitsweise der Nutzer einfügt. Dieses Portfolio kann beispielsweise aus einer internen Informationswebsite als „Single Point of Information“ bestehen, auf der die neuesten Entwicklungen und Verordnungen zum Gesetz, aber auch Best Practices und Onlinetrainings angeboten werden. Von hier aus könnte dann auf alle weiteren Tools zugegriffen werden, welche speziell für die einzelnen analysierten Problemfelder entwickelt wurden.

Dazu könnte beispielsweise auch ein Handbuch zählen, in denen der Handlungsrahmen praxisnah übersetzt und erklärt wird. Es informiert darüber, was die im DSGVO benannte „Transparenzpflicht“ in der Anwendung für unterschiedliche Systeme und Datenkategorien bedeutet. Vor allem wenn der gesetzliche Wortlaut erheblichen Auslegungsspielraum zulässt, ist es für die Nutzer wertvoll, einen Handlungsrahmen zu erhalten, Best Practices und Beispiele vergleichen und erfahrene Berater für Hilfe kontaktieren zu können.

Des Weiteren ist eine Checkliste für alle Compliance-bezogenen Prozesse hilfreich, um sicherzustellen, dass alle Tools und Methoden vom Entwicklungsteam richtig eingesetzt werden. Ferner sollte ein Risiko-Assessment die zu beachtenden (Detail)-Regelungen aufzeigen und entsprechende Lösungs- und Risikominimierungs-Vorschläge sowie Roadmaps bereithalten. Für die abschließende Prüfung ist zudem ein Prozess essentiell, der wichtige Maßnahmen je betitelter Risikohöhe abfragt und zur Sicherung dokumentiert.

Fazit

Erst seit kurzem werden die Strafhöhen des DSGVO vollumfänglich angewendet, was weitreichende Folgen für Unternehmen und Einzelpersonen haben kann. Zur Absicherung der Wettbewerbsfähigkeit benötigen Unternehmen neu-gedachte, innovative Prozesse und Methoden zur Integration von Gesetzen in ihr operatives Geschäft, denn die meisten Unternehmen sichern die Gesetzeskonformität eigener Produkte oder Services mit komplizierten, statischen Prozessen ab. Unabhängig vom gewählten Ansatz glauben wir, dass Umsetzungs- und Übersetzungshilfen von Gesetzen und Regulatorik die Anwender befähigt, gesetzeskonforme datengetriebene Innovationen zu entwickeln und damit Zukunftssicherheit für das unternehmerische Handeln herstellt.